AIガバナンスに関してご説明をした記事 攻めと守りの「AIガバナンス」:経産省ガイドラインの実践と運用課題 でも触れております、AIの安全な運用のためのキーコンセプトとして示されているのが「Human-in-the-loop(HITL:人間を介在させるプロセス)」です。

AIの生成物にはハルシネーション(もっともらしい嘘)や不適切な表現のリスクが常に付いて回ります。本記事では、AIガバナンスの実効性を高めるためのHITLの実装ステップについて、運用の現場視点から詳しく解説します。

なぜAIガバナンスに「人の介在(HITL)」が必要なのか

AI技術が飛躍的な進歩を遂げた現在においても、AI単体で社会的・倫理的な「文脈」を完全に理解し、100%の安全性を担保し続けることは極めて困難です。技術的な限界を補い、企業としての信頼性を維持するためには、プロセスの要所に人間の判断を介在させる「Human-in-the-loop(HITL)」が不可欠です。その理由は、以下の3点に集約されます。

ハルシネーションによる「誤情報の拡散」を防止する

生成AIの最大の課題の一つが、事実とは異なる情報をさも正解かのように回答する「ハルシネーション」です。AIは確率統計的に「もっともらしい言葉」を繋ぎ合わせる仕組みであるため、自ら情報の真偽を検証することには限界があります。 専門知識を持った人間が最終的な出力を検証するプロセスを設けることで、誤情報の拡散による社会的混乱や、自社サービスの信頼失墜を未然に防ぐことが可能となります。

多様な「社会的文脈」や「倫理観」を解釈する

「不適切な表現」の定義は、業界独自の商習慣や、その時々の社会情勢、さらには受け手の文化的な背景によって刻一刻と変化します。静的な学習データに基づくAIには、こうした流動的な「ニュアンス」や「倫理的配慮」をリアルタイムで判断することは困難です。 人間の感性や経験を介在させることで、AIには見抜けない微細な違和感や、社会倫理に抵触するリスクを高い精度で察知し、適切な軌道修正を行うことができます。

企業の「アカウンタビリティ(説明責任)」を担保する

経済産業省のガイドラインでも重視されているのが、AIの利用に伴う透明性と説明責任です。万が一、AIの出力によって権利侵害や不利益が生じた際、すべての判断をブラックボックス化したAIに委ねていた場合、企業としての管理体制が厳しく問われることになります。 「重要度の高い判断には人間が介在し、最終的な確認を行っていた」という運用のエビデンスがあることは、インシデント発生時における企業の誠実な姿勢と、適切な管理能力を証明する重要な根拠となります。

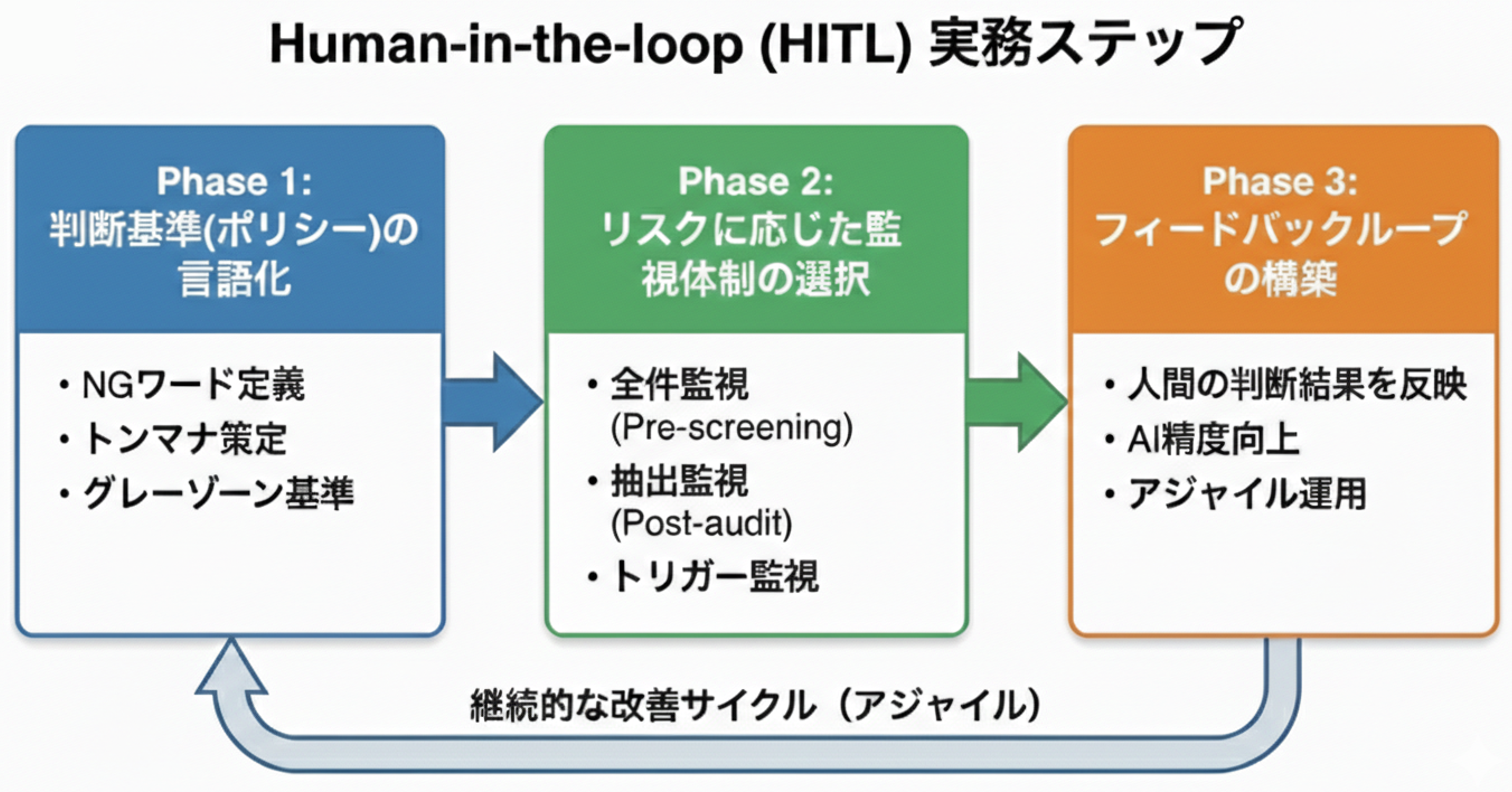

HITL運用のための3フェーズ・マニュアル

HITLを単なる「手作業のチェック」に終わらせないためには、以下の3つのフェーズによる体系的な設計が必要です。

フェーズ①:判断基準(ポリシー)の言語化

AIの出力を評価するための「物差し」を定義します。

- NGワード・表現の定義

公序良俗、差別、権利侵害など、明確な基準を設ける - トーン&マナーの策定

自社ブランドとして相応しい表現であるか。 - グレーゾーンの処理

現場スタッフが判断に迷った際の「エスカレーション先」を明確にしておく。

フェーズ②:リスクに応じた監視体制の選択

すべてのAI出力を100%監視するのは、コスト面でもスピード面でも現実的ではありません

- 全件監視(Pre-screening)

公開前に必ず人間がチェック。医療、金融、法務などの高リスク領域に適用。 - 抽出監視(Post-audit)

出力後に一定割合をランダムにチェック。AIの精度評価と再学習に活用。 - トリガー監視

AIの確信度が低い場合や、ユーザーから通報があった場合のみ人間が介入。

フェーズ③:フィードバックループの構築

人間の判断結果を、プロンプトの改善やAIモデルの微調整に反映させます。これにより、AIの出力精度自体を継続的に向上させる「アジャイル・ガバナンス」を実現します。

自社運用における「実務上のボトルネック」

いざHITLを内製しようとすると、多くの企業が以下の課題に直面します。

- 24時間365日の稼働負荷

AIサービスは深夜・休日も稼働します。これに伴う監視リソースの確保は、社内では大きな負担となります。 - 判断の属人化

監視スタッフによって判断基準がバラつくと、ガバナンスとしての実効性が失われます。 - 心理的・教育的コスト

不適切なコンテンツを大量にチェックし続けるスタッフのメンタルケアや、常に最新のAIトレンドを追う教育体制の維持が必要です。

イー・ガーディアンのBPOが提供する、

一歩進んだAIガバナンス

AIガバナンスの実装において、専門的な外部リソース(BPO)を活用することは、コストとリスクを最適化する有効な戦略です。イー・ガーディアンでは、専門家として長年の投稿監視で培ったノウハウを「AI時代」に適応させて提供しています。

- 高品質なアノテーションと判定基準の策定

曖昧な基準を「誰が判定しても同じ結果になる」レベルまで標準化し、高品質なHITL運用を支援します。 - 専門チームによるインシデント対応

万が一の事態にも迅速に対応し、貴社の説明責任(アカウンタビリティ)の確保に貢献します。 - 最新のガイドラインへの準拠

常に変化する法規制や社会的動向を捉えた、柔軟な運用体制を構築します。

信頼されるAI活用のために

AIガバナンスは、単なるリスクヘッジではありません。実効性のある運用体制(HITL)を構築し、社会からの信頼を得ることこそが、AIビジネスを成功に導く最短ルートです。

イー・ガーディアンは、ハルシネーション対策からセキュリティ診断、そして運用の現場を支えるHITLの構築まで、多角的なソリューションで貴社のAI活用をサポートいたします。AIの可能性を最大限に引き出し、持続可能な活用を実現するための一助として、弊社の知見をご活用いただけますと幸いです。実務レベルでの運用設計に課題をお持ちの際は、ぜひお気軽にご相談ください。

■サービスに関するお問い合わせはこちら