2017年に社会問題化した「エルサゲート」。実は2026年現在、生成AIによりさらに巧妙化しています。本記事ではコンテンツ監視のプロが、その歴史から最新のAIリスク、企業が取るべきブランドセーフティ対策までを解説します。

1. エルサゲートとは

この言葉が世界中で認知されるようになったのは、2017年の夏ごろのことです。世界的に有名なアニメーション映画のキャラクター「エルサ(Elsa)」と、社会的な大スキャンダルを意味する接尾辞「ゲート(Gate)」を組み合わせて誕生した造語が、エルサゲートです。

当初は一部のSNSや掲示板(Reddit)で「子供に見せている動画の様子がおかしい」と話題になる程度でしたが、同年11月、作家ジェームズ・ブライドル氏が発表した「Something is wrong on the internet(インターネットの何かがおかしい)」というレポートによって、その異常性が世界中に白日の下にさらされることとなりました。

2. エルサゲートの「アルゴリズムの罠」

エルサゲートがこれほどまでに深刻視された理由は、その「極めて巧妙な偽装」にあります。

動画のタイトルには、「Learn Colors(色を学ぼう)」「Nursery Rhymes(童謡)」といった、保護者が安心して検索するようなキーワードが並んでいました。サムネイルも、子供たちが大好きな誰しもが見覚えのある人気キャラクターなどが明るい色彩で描かれています。しかし、動画を再生して数分経つと、内容は一変します。

- キャラクターが注射器で執拗に刺される

- 拉致や監禁を思わせる過激な描写

- 排泄物や性的暗示を含む、生理的な不快感を煽るシーン

これらは、YouTube Kidsなどのフィルタリングをかいくぐるために計算されており、AIの自動判定をすり抜けて、無防備な子供たちの画面に表示され続けていたのです。

3. エルサゲートが突きつけたブランドセーフティの本質的課題

この問題は、保護者だけでなく、広告を出稿する「企業」にとっても悪夢となりました。 当時、世界的なスポーツブランドや飲料メーカー、大手金融機関の広告が、これらの有害動画の再生前に流れていたことが発覚したのです。「自社の広告費が、子供にトラウマを与える動画の収益源になっている」。この事実は、企業のブランドイメージに計り知れないダメージを与えました。

結果として、多くのグローバル企業がプラットフォームへの広告出稿を一斉に停止する事態に発展。これは後に、インターネット広告の信頼性が問われる「アドポカリプス(広告の黙示録)」という大きなうねりの一端となりました。

4. エルサゲートは過去の事件ではない

2017年の騒動から数年が経ち、プラットフォーム側の規制も強化されました。しかし、これで問題が解決したわけではありません。むしろ現在は、生成AIの普及により、かつてとは比較にならないスピードで、より自然で巧妙な「不適切コンテンツ」が量産されるリスクに直面しています。

エルサゲートが私たちに残した教訓。それは、「AIやアルゴリズムだけに頼る監視には限界がある」ということです。なぜ、数年前の問題が今もなお企業の脅威となっているのか。私どもイー・ガーディアンがコンテンツ監視のプロの視点から、その実態と企業が取るべき対策を解説します。

5. 【2026年最新】生成AIがもたらす「新型エルサゲート」の脅威

かつてのエルサゲートは、人間が手作業(あるいは簡易的な自動化)で作成したものでした。しかし現在、コンテンツを取り巻く環境は激変しています。

生成AIによる「量産」と「高度化」 生成AIの進化により、高画質なアニメーションや実写に近い映像を、コストをかけずに大量生成することが可能になったことで、従来の監視網を数で圧倒する「コンテンツの洪水」が起きています。

ディープフェイク技術の悪用によって特定のキャラクターだけでなく、実在の人物や著名人に似せた「不適切な動画」も容易に作成できるようになりました。これは児童への悪影響のみならず、企業のパブリシティ権を侵害する新たなリスクとなっています。「意味」を隠す巧妙なメタデータ AIによる自動判定を避けるため、映像の内容とは全く無関係な、健全な知育キーワードやタグを学習させて「偽装」する技術も高度化しています。

6. なぜ「システムによる自動検知」だけでは防げないのか

多くのプラットフォームがAI監視を導入していますが、それでも「すり抜け」は発生します。そこには、今現在で機械学習特有の限界があるからです。

「文脈(コンテキスト)」の判断 例えば「注射器」が映ったとき、それが「医療教育」なのか「虐待的な演出」なのか。映像の断片的な情報だけでは、AIはその意図までを正確に判別することが困難です。

「違和感」という非言語情報のキャッチ エルサゲートに共通する「不気味さ」「生理的な不快感」は、数値化しにくい感性の領域です。子供が受ける心理的ダメージを未然に防ぐには、人間が持つ「直感的な違和感」が不可欠なフィルターとなります。

7. ブランドと未来を守る「ハイブリッド監視」の重要性

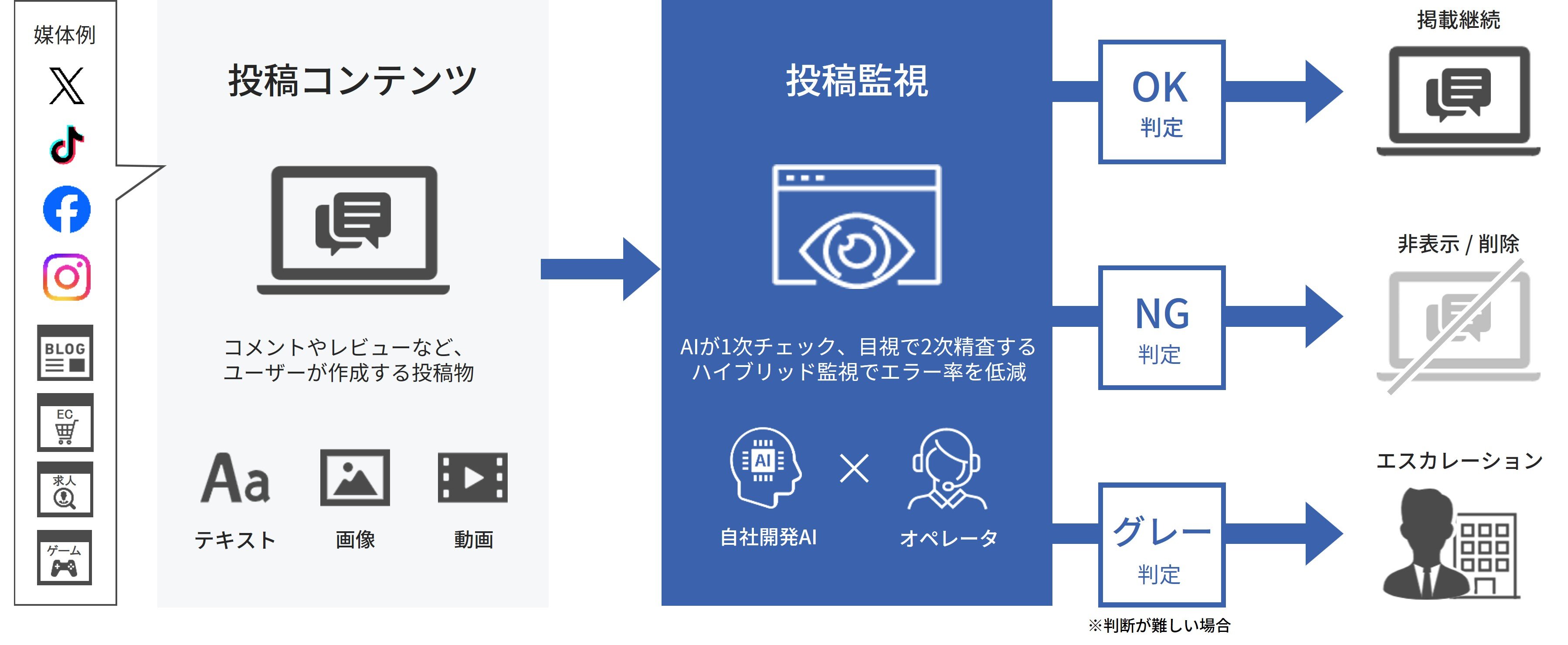

これら進化したリスクに対し、企業(広告主・プラットフォーム運営者)はどう立ち向かうべきでしょうか。イー・ガーディアンでは、AI×人の「ハイブリッド監視」を推奨しています。

まず、自社開発した高精度AIによる一次スクリーニングで、膨大な投稿データから明らかな規約違反や既知の有害パターンを瞬時に除外します。

続いて、AIでは判定が困難な「グレー」については、専門チームが目視による審査を行います。隠語や新たな手口などの最新のトレンドを熟知した監視スタッフ、その知見を活かして文脈を深く読み解き、正確な最終判断を下します。

単なる公序良俗の維持にとどまらず、貴社のブランドポリシーに合わせた独自の基準を策定することで、極めて精度の高いブランドセーフティを実現します。

エルサゲート問題は、単なる不適切動画の投稿に留まらず、AI(レコメンドアルゴリズム)の選別基準が社会倫理と乖離したことで起きた「AIガバナンスの欠如」の象徴とも言えます。さらに、近年では生成AIの普及により、ますます巧妙で大量の不適切コンテンツが生成されるリスクも高まっています。

こうした事態を未然に防ぐため、企業が持つべき指針や運用法等についてもご案内をしています。 【関連記事:攻めと守りの「AIガバナンス」:経産省ガイドラインの実践と運用課題】

8. 結論:安全なコンテンツ環境が企業価値の源泉になる

「エルサゲート」という言葉が生まれてから数年。インターネットの風景は変わりましたが、悪意の形が変わっただけで、リスクの本質は変わっていません。

むしろ、ESG経営やコンプライアンスが重視される現代において、ブランドセーフティへの取り組みは、単なる事故への「受動的な対処」ではありません。それは、企業の社会的な信頼を強固にし、持続的な成長を支えるための「投資」と言えます。

不適切コンテンツの監視や、ブランド毀損のリスク対策でお悩みの際は、ぜひ専門家である私どもにご相談ください。健全なデジタル社会の実現を、共に目指してまいりましょう。

■投稿監視サービス詳細はこちら

■ 広告関連サービス一覧はこちら

本サービスに関する資料・お問い合わせはこちらから!