生成AIの普及により、カスタマーサポートの現場も劇的な変革を迎えています。ビジネスプロセスへのAI導入は、生産性向上や労働力不足の解消に向けた「Society 5.0」実現の鍵となりますが、同時に「ハルシネーション」や不適切な情報生成といった新たな社会的リスクも顕在化しています。

AIガバナンスに関してご説明をした記事【攻めと守りの「AIガバナンス」:経産省ガイドラインの実践と運用課題】でも触れました「AI事業者ガイドライン(第1.1版)」では、AIの安全安心な活用に向けた統一的な指針が示されています。

その中でも特に、直接ユーザーと接する「カスタマーサポート」の領域において、企業はいかに「説明責任」を果たすべきなのか、本稿でガイドラインの最新指針に基づき、顧客からの信頼を支える「AI専用カスタマーサポート」の運用設計とガバナンスの実践手法を深掘りします。

顧客接点で問われる「説明責任(アカウンタビリティ)」の本質

AIガバナンスの定義とは、「AIの利活用によって生じるリスクを受容可能な水準で管理しつつ、便益を最大化すること」です 。カスタマーサポート現場において、この「便益」と「リスク」のバランスを保つための核心となるのが「説明責任」です。

「透明性」と「説明責任」

ガイドラインにおいて、この2つの概念は明確に定義し分けられています。

透明性(Transparency):

AIを利用している事実や、データ収集の手法、AIモデルの能力と限界について、ステークホルダーへ合理的な範囲で情報を提供すること。

説明責任(Accountability):

AIに関する事実上・法律上の責任を負うこと、およびその責任を負うための前提条件(トレーサビリティ等)を整備すること。

AIが誤った情報を提供し、ユーザーが損害を被った際、企業は「AIが自律的に回答したから」という理由で責任を免れることはできません。万が一の事態に備え、意思決定プロセスを文書化し、適切なログを保存することで、事後的に説明可能な状態を確保しておくことが不可欠です。

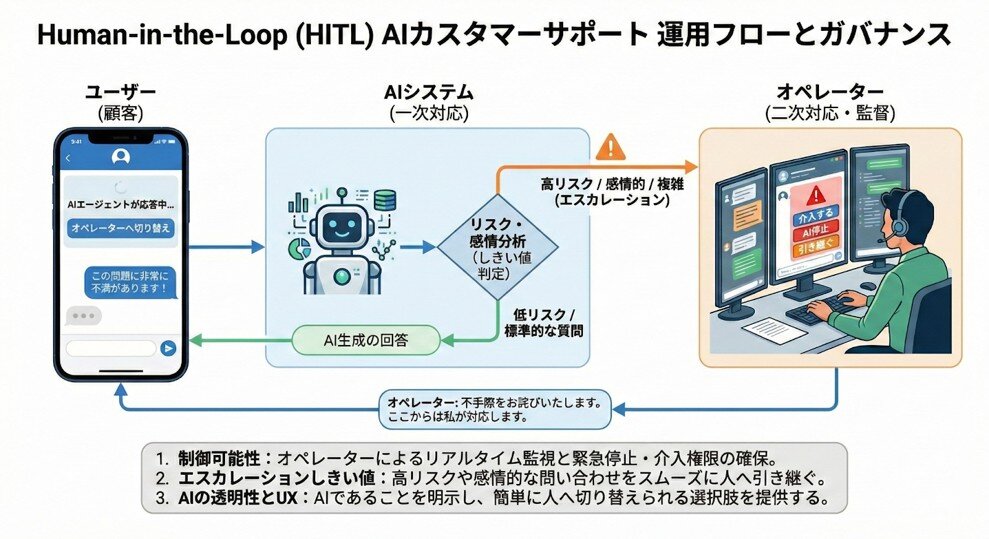

人間の尊厳を守る「Human-in-the-Loop」の実装設計

AIの安全な運用を支えるキーコンセプトが、人間の判断をプロセスに介在させる「Human-in-the-Loop」です。既存記事【AIガバナンスを形にする『Human-in-the-loop』実装ガイド】ではその基本ステップを解説しましたが、カスタマーサポート実務においてはさらに踏み込んだ設計が求められます。

人間の尊厳を守る「Human-in-the-Loop」の実装設計

人間は、AIによる評価や予測を過度に信頼し、鵜呑みにしてしまう「自動化バイアス」に陥りやすい特性があります。これを防ぐため、カスタマーサポートの運用設計には以下の視点を盛り込みます。

制御可能性(Controllability)の確保:

人間がAIの出力を常時モニタリングし、不適切な回答に対しては即座に介入・停止・修正ができる「緊急停止ボタン」に相当する権限をオペレーターに持たせる。

エスカレーションのしきい値設定:

AIが判断に迷う高リスクな問い合わせや、感情的なユーザーからの要望については、AI単独で完結させず、シームレスに人へとバトンタッチするフローを構築する。

ユーザーへの「AI明示」:

ユーザーがAIと対話していることを認識できるようにし、必要に応じて有人対応への切り替え手段を提示するなどの「UXデザイン」を通じたガバナンスを実践する。

アジャイル・ガバナンスによる継続的改善モデル

最新のガイドラインが最も強調しているのが、固定的なルールを一度作って終わりにするのではなく、外部環境の変化に合わせて改善し続ける「アジャイル・ガバナンス」の思想です。

カスタマーサポート現場におけるAI運用は、アジャイル・ガバナンスの基本的なモデルとなっている「環境・リスク分析」「ゴール設定」「システムデザイン」「運用」「評価」というライフサイクルを継続的に回転させることが重要とされています。

環境・リスク分析:

最新のインシデント事例や社会的受容の変化を鑑み、自社のAIカスタマーサポートがもたらしうる負のインパクトを分析する。

ゴール設定:

分析に基づき、自社が守るべきAIポリシーや品質基準を策定する。

システムデザイン:

定めたゴールを達成するため、技術的対策(ガードレール等)と組織的対策(教育、BPO活用等)を組み合わせて設計する。

運用:

実際の対話ログをリアルタイムで収集・記録し、透明性を確保する。

評価:

運用状況を継続的にモニタリングし、設定したゴールと乖離がないかを独立した視点で検証する。

カスタマーサポート現場におけるサンプリング監査の「4つの評価軸」

AIガバナンスの実践において、最も頭を悩ませるのが「具体的に何をチェックすればいいのか」という点です。総務省・経済産業省が策定した『AI事業者ガイドライン(第1.1版)』では、AIガバナンス・ゴールとの乖離を防ぐための「実務的な対応例(別添2)」が示されています 。これをカスタマーサポートの実務に即して整理すると、主に以下の4つの監査軸に集約されます。

①安全性(Safety)

生命・身体・財産だけでなく、精神や環境への配慮も含まれます。

監査例:自傷行為の助長、公序良俗に反する回答、または不正確な情報による経済的損失のリスクが含まれていないか。

②公平性(Fairness)

人種、性別、年齢、宗教などによる不当で有害な偏見や差別をなくす努力が求められます。

監査例:学習データやプロンプトに潜むバイアスにより、特定のユーザー層に対して不利益な回答や差別的な表現を行っていないか。

③プライバシー保護(Privacy)

関連法令の遵守はもちろん、人々の「合理的な期待」を踏まえた対応が必要です。

監査例:プロンプトへの個人情報の不適切入力に対する警告機能や、出力における個人情報のフィルタリングが正常に機能しているか。

④透明性と正確性

情報の出所や、AIの限界についての説明可能性を確保します。

監査例:ハルシネーションを事実のように断言していないか。ナレッジ(RAG)との整合性が保たれているか。

イー・ガーディアングループが提供する実効性のあるAIガバナンス

AIガバナンスの実践において、多くの企業が直面するのが「リソースの確保」と「判断の属人化」という壁です。イー・ガーディアンでは、20年以上にわたるカスタマーサポート・投稿監視の運用実績と、最新のAIセキュリティ知見を融合させた、カスタマーサポートのリスクマネジメントが可能です。

専門家による客観的なモニタリング:

ガイドラインが推奨する「開発・運用から独立した第三者」としての視点から、AIの出力を高精度に監査します。

フィードバックループの伴走支援:

監査結果をナレッジの更新やプロンプトエンジニアリングへ即座に反映させ、AIの回答精度を向上させるアジャイルな体制を構築します。

説明責任の代行とエビデンス確保:

万が一のインシデント発生時には、専門オペレーターによる迅速なリカバリー対応を実施するとともに、詳細な事故原因分析と改善策の報告をサポートし、企業の「説明責任」の遂行に貢献します。

結びに:安全なAI カスタマーサポートが顧客体験を次のステージへ

AIガバナンスは、ビジネスの「ブレーキ」ではありません。実効性のある運用体制を構築し、社会や顧客からの信頼を得ることこそが、AIビジネスを成功に導く最短ルートです。適切なガバナンスという土台(守り)があってこそ、AIによる迅速かつパーソナライズされたおもてなし(攻め)は真の価値を発揮します。

イー・ガーディアンは、貴社のAI活用が顧客体験(CX)を飛躍させるための「ライセンス」となるよう、全力でサポートいたします。本記事の内容や、具体的なAI監査体制の構築に関するご相談は、こちらのお問い合わせフォームからお気軽にご連絡ください。

サービスに関するお問い合わせ・お見積もりはこちらから